Traduction du dossier Chat Control 2.0 de Patrick Breyer

L’article ci-dessous est une traduction et adaptation de l’article https://www.patrick-breyer.de/en/posts/chat-control/ provenant du blog de Patrick Breyer.

Traduction mise à jour le : 15/04/2024

Patrick Breyer est un député européen membre du Parti Pirate qui représente les oppositions au règlement Chat Control.

Avertissement Cet article parle d’abus pédosexuels.

Note de traduction : « Chat Control » ou « Chat Control 2.0 » est le surnom donné à la proposition de règlement européen qui cherche à généraliser l’analyse automatisée des conversations numériques privées à des fins de détection de contenu pédopornographique (aussi appelé « CSAM » ou « CSEM » pour « Child Sexual Abuse/Exploitation Material ») ou de corruption de mineur (« child grooming ») à l’ensemble des opérateurs de services de messageries. Le nom officiel de cette proposition est « Proposal for a Regulation laying down rules to prevent and combat child sexual abuse ».

Chat Control : La fin de la vie privée dans nos conversations numériques

L’Union européenne voudrait obliger les opérateurs de services de messagerie à chercher de manière automatique les contenus suspects dans les conversations et messages privées ainsi que les emails.

L’objectif déclaré : lutter contre les contenus pédopornographiques (« CSEM »).

Leur solution : la surveillance de masse par la lecture et l’analyse automatique de chaque message envoyé en temps réel, sonnant la fin du secret des correspondances numériques.

Parmi les autres conséquences (qui seront tout aussi inefficaces) de cette proposition de règlement figurent : les blocages réseaux, le filtrage des fichiers privés dans le cloud, la vérification obligatoire de l’âge des utilisateurs mettant fin aux communications anonymes, la censure dans les magasins d’applications, et l’exclusion des mineurs du monde numérique.

Chat Control 2.0 dans tous les smartphones.

Le 11 mai 2022, la Commission européenne a présenté une proposition qui rendrait l’analyse automatisée des communications privées obligatoire pour tous les opérateurs de services de messagerie ou d’email, et s’appliquerait même au services chiffrés aujourd’hui de bout en bout. En amont de cette proposition, une consultation publique par la Commission a montré que la majorité des répondants, citoyens comme parties prenantes, sont opposés à une obligation d’utiliser la surveillance des conversations. Plus de 80% des répondants s’opposaient à son application aux communications chiffrées de bout en bout.

Un règlement autorise actuellement les opérateurs de scanner les communications sur la base du volontariat (surnommé « Chat Control 1.0 »). Aujourd’hui, seuls quelques services étasuniens non chiffrés comme Gmail, Facebook/Instagram, Skype, Snapchat, les emails iCloud et le tchat XBox inspectent volontairement les communication privées (plus de details ici). La Commission européenne prédit une multiplication par 3,5 fois du nombre de signalements automatiques suite à la l’implémentation de la proposition Chat Control 2.0 (par 354%).

Le parlement s’est positionné en grande majorité contre la surveillance systématique des communications numériques. Au sein du conseil de l’UE, le clivage entre les partisans et les opposants de la surveillance obligatoire de toutes les communications numériques ne permet de trouver une position commune, la commission européenne a proposé une prolongation de 2 ans du règlement Chat Control V1 (proposition laissant le choix aux fournisseurs de services de contrôler les messages transitants sur leurs plateformes) en novembre 2023.

Une victime d’abus pédosexuel et l’eurodéputé Patrick Breyer ont intenté des actions en justice pour mettre fin à la surveillance systématique des messages par les grandes plateformes de messagerie étatsuniennes.

Voici ce que la proposition implique réellement :

| Proposition Chat Control 2.0 de la Commission européenne | Conséquences | Position du Parlement européen | Position du Conseil (en cours d’élaboration) |

| Sont envisagées : la surveillance des conversations, le blocage réseau, la vérification obligatoire de l’âge pour les applications de communication ou de stockage, la vérification de l’âge pour les magasins d’applications et l’interdiction pour les mineurs d’installer de nombreuses applications. | Pas de surveillance ni de blocages réseaux, pas de vérification obligatoire de l’âge des utilisateurs, pas d’exclusion de l’utilisateur sur le critère de son âge. | Aucune modification par rapport à la proposition de la Commission | |

| Tous les services fournis contre une rémunération (y compris les services financés par la publicité) entrent dans le champ d’application du texte, sans limite de taille, de nombre d’utilisateurs, etc. | Seuls les services non commerciaux et non financés par la publicité, comme beaucoup de logiciels libres ne sont pas concernés par le texte | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| L’autorité du pays d’établissement du fournisseur est tenue d’ordonner la mise en place d’un système surveillance des messages. | Voir l’article 33 de la proposition | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| Les services de communication concernés incluent la téléphonie, les courriers électroniques, les messageries, les conversations (y compris dans les jeux, sur les applications de rencontre, et c.), la visioconférence | Le texte, les images, les vidéos et la parole pourront être analysés | La téléphonie est exclue ainsi que les SMS mais les courriels, messagerie, tchat public, les services de visioconférence seront surveillés. | Aucune modification par rapport à la proposition de la Commission |

| Les services de messagerie chiffrée de bout en bout ne sont pas exclus du champ d’application | Les fournisseurs de services de communication chiffrés de bout en bout vont devoir analyser les messages sur chaque smartphone (analyse côté client) et, en cas de correspondance, signaler le message à la police. | Les services de messagerie chiffrés de bout en bout sont exlus du champ d’application | Aucune modification par rapport à la proposition de la Commission |

| Dans les services d’hébergement concernés, il y a l’hébergement web, les réseaux sociaux, les services de diffusion de vidéo, l’hébergement de fichiers et les services en ligne. | Même le stockage personnel, qui n’est pas partagé, comme le service iCloud d’Apple, seront soumis à chat control. | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| Les services qui sont susceptibles d’etre utilisés pour du contenu illégal ou du pédopiégeage devront obligatoirement fouiller le contenu des communications personnelles et les données stockées avant tout soupçon et ce de manière généralisée | Étant donné que n’importe quel service est probablement aussi utilisé à des fins illégales, tous les services seront dans l’obligation de déployer chat control. | Seule la surveillance ciblées de personnes et de groupes spécifiques dont on peut raisonnablement penser qu’ils sont liés à du contenu pédopornographique est autorisée | Aucune modification par rapport à la proposition de la Commission |

| L’autorité d’un pays doit exiger à un fournisseur de service hébergé sur son térritoire d’appliquer le système ChatControl | L’application du texte et le moment de son application est laissé à la décision des autorités du pays | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

ChatControl implique des recherches automatisées d’images et de vidéos connues du CSEM. Les messages/fichiers suspects seront signalés à la police. | Selon la police fédérale suisse, 87% des rapports qu’elle reçoit (généralement basés sur la méthode de hachage) ne sont pas pertinents d’un point de vue pénal. | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| Les services d’hébergement comme les hébergeurs de pages web, les réseaux sociaux, les services de streaming vidéo, les services d’hébergement de fichiers et de cloud, sont concernés par le texte. | Même les fichiers personnels comme les service iCloud ou Dropbox sera soumis à la surveillance obligatoire | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| ChatControl implique des recherches automatisées d’images et de vidéos connues du CSEM. Les messages/fichiers suspects seront signalés à la police. | La recherche automatique de représentations d’abus inconnues est une procédure expérimentale faisant appel à l’apprentissage automatique (« intelligence artificielle »). Les algorithmes ne sont pas accessibles au public et à la communauté scientifique, et le projet ne prévoit aucune obligation de divulgation. Le taux d’erreur est inconnu et n’est pas limité par le projet de règlement. On peut supposer que ces technologies donnent lieu à des quantités massives de fausses déclarations. Le projet de législation autorise les fournisseurs à transmettre à la police des rapports de concordance automatisés sans qu’ils soient vérifiés par des humains. | Aucune modification par rapport à la proposition de la Commission | Aucune modification par rapport à la proposition de la Commission |

| Le contrôle des conversations implique des recherches sur les machines pour détecter d’éventuelles pratiques de manipulation d’enfants ; les messages suspects seront signalés à la police. | La recherche automatique de pédophilie potentielle est une procédure expérimentale qui fait appel à l’apprentissage automatique (« intelligence artificielle »). Les algorithmes ne sont pas accessibles au public et à la communauté scientifique, et le projet ne contient pas d’obligation de divulgation. Le taux d’erreur est inconnu et n’est pas limité par le projet de règlement. On peut supposer que ces technologies donnent lieu à un grand nombre de fausses déclarations. | Pas d’autorisation pour les recherches automatiques de pédophilie potentielle. | Pas d’autorisation pour les recherches automatique de pédophilie potentielle. |

| Les services de communication susceptibles d’être utilisés à des fins de pédophilie (donc tous) doivent vérifier l’âge de leurs utilisateurs. | Dans la pratique, la vérification de l’âge implique une identification complète de l’utilisateur, ce qui signifie que les communications anonymes par courrier électronique, messagerie, etc. seront effectivement interdites. Les dénonciateurs, les défenseurs des droits de l’homme et les groupes marginalisés comptent sur la protection de l’anonymat. | Pas d’obligation de vérification de l’age des utilisateurs | Aucune modification par rapport à la proposition de la Commission |

| Les magasins d’applications doivent vérifier l’âge de leurs utilisateurs et empêcher les enfants et les jeunes d’installer des applications susceptibles d’être utilisées à des fins de sollicitation. | Tous les services de communication tels que les applications de messagerie, les applications de rencontres ou les jeux peuvent être utilisés à mauvais escient pour la sollicitation d’enfants (child grooming) et leur utilisation sera bloquée pour les enfants/jeunes. | Lorsqu’une application requiert le consentement pour le traitement des données, les magasins d’applications dominants (Apple Store, Android Store) doivent faire un effort raisonnable pour s’assurer du consentement des parents pour les utilisateurs de moins de 16 ans | Aucune modification par rapport à la proposition de la Commission |

| Les fournisseurs d’accès à Internet peuvent être obligés de bloquer l’accès aux images et vidéos interdites et inamovibles hébergées en dehors de l’UE au moyen d’un blocage de réseau (blocage d’URL). | Le blocage des réseaux est techniquement inefficace et facile à contourner, et il aboutit à la construction d’une infrastructure de censure technique. | Les fournisseurs d’accès internet peuvent être obligé d’appliquer des blocages | Aucune modification par rapport à la proposition de la Commission |

Les changements proposés par le Parlement européen :

En novembre 2023, le Parlement européen a adopté à la quasi-unanimité un mandat de négociation pour la proposition de loi. Avec l’eurodéputé du Parti Pirate Patrick Breyer, l’opposant le plus déterminé au texte s’est assis à la table des négociations. Le résultat : le Parlement veut déjouer la proposition extrême de la Commission européenne :

- Nous voulons préserver le secret numérique des correspondances et supprimer la surveillance systématique des messageries qui viole les droits fondamentaux et n’a aucune chance devant les tribunaux. L’actuelle analyse volontaire des messages privés (et non des réseaux sociaux) par les opérateurs internet américains est progressivement supprimée. La surveillance ciblée des télécommunications et les perquisitions ne seront autorisées que sur mandat judiciaire et limitées aux personnes ou groupes de personnes soupçonnés d’être liés à des contenus pédopornographiques.

- Nous voulons préserver la confiance dans le chiffrement de bout en bout. Nous excluons clairement ce que l’on appelle l’analyse coté client, c’est-à-dire l’installation de fonctionnalités de surveillance et de failles de sécurité dans nos smartphones.

- Nous voulons garantir le droit à la communication anonyme et supprimer la vérification obligatoire de l’âge des utilisateurs de services de communication. Les lanceurs d’alerte pourront ainsi continuer à divulguer des actes répréhensibles de manière anonyme, sans avoir à montrer leur carte d’identité ou leur visage.

- Supprimer au lieu de bloquer : le blocage de l’accès Internet doit être facultatif. Les contenus légaux ne doivent en aucun cas être bloqués de manière collatérale.

- Nous rejetons l’assignation à résidence numérique : nous ne voulons pas obliger les magasins d’applications à empêcher les jeunes de moins de 16 ans d’installer des applications de messagerie, de réseaux sociaux, et de jeux « pour leur propre protection », comme cela a été proposé par la Commission. Le Règlement Général sur les Protection des Données personnelles (RGPD) doit être maintenu.

Le Parlement veut protéger les jeunes et les victimes d’abus bien plus efficacement que la proposition extrême de la Commission européenne :

- La sécurité dès la conception : afin de protéger les jeunes de la corruption de mineurs, le Parlement souhaite que les services Internet et les applications soient sécurisés dès leur conception et par défaut. Il doit être possible de bloquer et de signaler d’autres utilisateurs. Ce n’est qu’à la demande de l’utilisateur qu’il doit être accessible au public et voir les messages ou les photos des autres utilisateurs. Les utilisateurs doivent être invités à confirmer leur identité avant d’envoyer leurs coordonnées ou des photos de nu. Les auteurs et victimes potentiels doivent être avertis lorsque cela est pertinent, par exemple s’ils tentent de rechercher des contenus abusifs à l’aide de certains mots de recherche. Les tchats publics présentant un risque élevé de corruption de mineur doivent être modérés.

- Afin de nettoyer le réseau des contenus d’abus sexuels sur les enfants, le Parlement souhaite que le nouveau Centre européen de protection de l’enfance recherche automatiquement et de manière proactive les contenus Internet accessibles au public pour y trouver des contenus pédopornographiques connus. Cette recherche pourrait également être utilisée sur le darknet et serait donc plus efficace que les mesures de surveillance privées des fournisseurs.

- Le Parlement souhaite obliger les fournisseurs qui ont connaissance de contenus manifestement illégaux à les retirer, contrairement à la proposition de la Commission européenne. Les forces de l’ordre qui auraient connaissance d’un contenu illégal seraient obligées de le signaler au fournisseur pour qu’il le retire. Ceci en réaction au cas de la plateforme Boystown hébergée sur le darknet, où les pires contenus pédopornographiques ont sciemment continué d’être diffusés pendant des mois avec l’aval de Europol.

Attention : Il ne s’agit que du mandat de négociation du Parlement, qui ne l’emporte généralement que partiellement. La plupart des gouvernements de l’UE continuent de soutenir la proposition initiale de Chat Control 2.0 de la Commission européenne sans compromis significatif. Cependant, de nombreux autres gouvernements empêchent un tel positionnement (minorité de blocage). Dès que les gouvernements de l’UE seront parvenus à un accord au sein du Conseil, le Parlement, le Conseil et la Commission entameront les négociations dites de trilogue sur la version finale du règlement. Patrick Breyer ou son successeur potentiel Anja Hirschel du Parti Pirate s’assiéront à nouveau à la table des négociations pour lutter contre Chat Control.

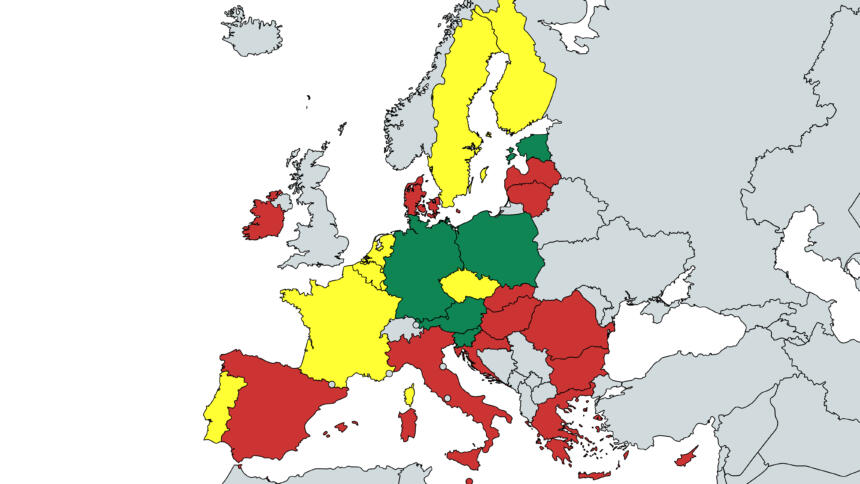

Position des gouvernements de l’UE au Conseil :

La plupart des gouvernements de l’UE continuent de soutenir la proposition extrême initiale de la Commission européenne sans y apporter d’améliorations significatives. Plusieurs autres gouvernements s’opposent toutefois à une telle position (une minorité), de sorte que les positions proposées par le Conseil ont déjà échoué à deux reprises.

Des vidéos supplémentaires sont disponible dans cette playlist.

Chronologie des négociations

2020 : La Commission européenne propose une législation « temporaire » permettant l’analyse de messagerie

La législation « temporaire » proposée [une dérogation à la directive 2002/58/EC communément appelée « directive ePrivacy » ou « directive vie privée et communications électroniques »] permet l’analyse de tous les messageries, et emails à la recherche d’images illégales de mineures ou de tentatives d’entrée en contact avec des mineur·e·s. Cela permet aux opérateurs de Facebook Messenger, Gmail, etc. de scanner tous les messages circulant sur leurs services à la recherche de texte ou d’images suspectes. Si un algorithme considère un message suspect, son contenu et ses métadonnées sont révélées (automatiquement et sans vérification humaine) à une organisation privée basée aux Etats-Unis d’Amérique, puis aux polices nationales du monde entier. Les utilisateur·ices signalé·e·s ne sont pas notifié·es.

6 juillet 2021 : Le Parlement européen adopte la législation permettant l’analyse de messagerie

Le Parlement européen vote en faveur de la dérogation à la directive « ePrivacy » qui permet aux opérateurs de messagerie et d’emails de surveiller ceux-ci. Des opérateurs de tels services basés aux Etats-Unis, comme Gmail et Outlook.com, commencent l’analyse automatisé des messages.

9 mai 2022 : Patrick Breyer, membre du Parlement européen, attaque en justice l’entreprise américaine Meta.

Selon la jurisprudence de la Cour de justice européenne, l’analyse automatisée, totale et permanente des communications privées viole les droits fondamentaux et est interdite (paragraphe 117).

Prof. Dr. Ninon Colneric, ex-juge de la Cour de justice européenne, conduit une analyse en profondeur des plans et conclue dans un avis juridique que les plans législatifs de l’UE concernant la surveillance de messagerie ne sont pas alignés avec la jurisprudence de la Cour de justice européenne, et violent les droits fondamentaux au respect de la vie privée, la protection des données et la liberté d’expression de l’ensemble des citoyen.nes européen.ennes. C’est sur ces faits que se base l’attaque en justice.

11 mai 2022 : La Commission a présenté une proposition visant à rendre obligatoire le surveillance des conversations pour les opérateurs de services.

Le 11 mai 2022, la Commission européenne a présenté une deuxième proposition législative, dans laquelle elle oblige tous les opérateurs de services de tchat, de messagerie et de courrier électronique à déployer cette technologie de surveillance de masse en l’absence de tout soupçon. Cependant, un sondage représentatif réalisé en mars 2021 montre clairement qu’une majorité d’européens s’oppose à la surveillance automatisée des conversations numériques (résultats détaillés du sondage ici).

Les 8 mai, 22 juin, 5 juillet, 20 juillet, 6 septembre, 22 septembre, 5 octobre, 19 octobre, 3 novembre et 24 novembre 2022

La proposition a été discutée au sein du groupe de travail « Application de la loi » du Conseil européen.

- 28 septembre 2022 : Atelier du Conseil sur les technologies de détection

- 10 octobre 2022 : La proposition a été présentée et discutée au sein de la commission LIBE [Commission des libertés civiles, de la justice et des affaires intérieurs] du Parlement européen (enregistrement vidéo).

- 3 novembre 2022 : Réunion du Conseil

- 24 novembre 2022 : Atelier du Conseil sur la vérification de l’âge et le chiffrement

- 30 novembre 2022 : Première réunion des rapporteurs fictifs de la LIBE

- 14 décembre 2022 : Réunion des rapporteurs fictifs de la LIBE (auditions)

- 10 janvier 2023 : Réunion des rapporteurs fictifs de la LIBE (auditions)

- 19 & 20 janvier 2023 : Réunion du groupe de travail « Application de la loi » du Conseil

- 24 janvier 2023 : Réunion des rapporteurs fictifs de la LIBE (auditions)

- 7 février 2023 : Réunion des rapporteurs fictifs de la LIBE (entreprises technologiques)

- 27 février 2023 : Réunion des rapporteurs fictifs de la LIBE

- 7 mars 2023 : Réunion des rapporteurs fictifs de la LIBE

- 16 mars 2023 : Groupe de travail « Application de la loi » du Conseil (projet de compromis discuté)

- 21 mars 2023 : Réunion des rapporteurs fictifs de la LIBE

- Fin mars : Soumission de l’analyse d’impact

- 13 avril 2023 : Déclaration de gouvernement fédéral allemand

- 13 avril 2023 : Présentation de l’analyse d’impact en LIBE

- 19 avril 2023 : Le rapporteur de la LIBE soumet un projet de rapport

- 25 avril 2023 : Groupe de travail « Application de la loi » du Conseil (projet de compromis discuté)

- 26 avril 2023 : Présentation du projet de rapport en LIBE

- 8-19 mai 2023 : Date limite de soumission des amendements

- 25-26 mai 2023 : Groupe de travail « Application de la loi » du Conseil (projet de compromis discuté)

- 31 mai, 7 juin, 28 juin, 5 juillet, 12 juillet, 19 juillet 2023 : Réunions des rapporteurs fictifs de la LIBE

- 8 & 9 juin 2023 : Adoption de l’orientation générale partielle par le Conseil pour la Justice et les Affaires intérieures

- 14 septembre 2023 : Groupe de travail du Conseil sur l’application de la loi (projet de compromis discuté)

- 17 septembre 2023 : Groupe de travail du Conseil sur l’application de la loi (projet de compromis discuté)

- 20 septembre 2023 : Réunion Coreper

- 16 octobre : Débat des ambassadeurs au COREPER

- 25 octobre 2023 : Audition LIBE de la commissaire Johansson sur des allégations de lobbying

- 14 novembre 2023 : Adoption à la quasi-unanimité par la commission LIBE de la position et du mandat du Parlement européen pour les négociations du trilogue

- 23 novembre 2023 : Confirmation du mandat de négociation adopté au sein de la commission LIBE en l’absence de demande de vote en plénière

- 30 november 2023 : La Commission propose l’extension de la surveillance volontaire des conversations (Chat Control 1.0)

- 1er décembre 2023 : La présidence du Conseil a informé le groupe de travail sur l’application de la loi de l’état d’avancement des travaux.

- 4 décembre 2023 : La Commission européenne a informé les ministres de la justice et des affaires intérieures

- 17 janvier 2024 : Projet de rapport sur l’extension de la surveillance volontaire de Chat Control 1.0

- 22 janvier 2024 : Date limite de soumission des amendements sur l’extension de la surveillance volontaire de Chat Control 1.0

- 25 janvier 2024 : Réunion des rapporteurs fictifs sur l’extension de la surveillance volontaire de Chat Control 1.0

- 29 janvier 2024 : Vote LIBE sur l’extension de la surveillance volontaire Chat Control 1.0

- 5 février 2024 : Annonce du vote en plénière sur le mandat du PE sur l’extension de la surveillance volontaire Chat Control 1.0

- 7 février 2024 : Vote en plénière sur le mandat du PE sur l’extension de la surveillance volontaire Chat Control 1.0

- 12 février 2024 : Trilogue sur l’extension de la surveillance volontaire des messageries (Chat Control 1.0)

- Deuxième semaine de février 2024 : Accord entre le Parlement européen et les gouvernements de l’UE (Conseil de l’UE) sur l’extension de la surveillance volontaire des messageries (Chat Control 1.0)

- 1er mars 2024 : Discussion du groupe de travail du Conseil chargé de l’application de la loi sur Chat Control 2.0.

- 4 mars 2024 : Vote de la commission LIBE sur le résultat du trilogue sur l’extension de la surveillance volontaire des messageries (Chat Control 1.0)

- 5 mars 2024 : Discussion des ministres de l’intérieur de l’UE sur la surveillance obligatoire des conversations (Chat Control 2.0)

- 19 mars 2024 : Discussion du groupe de travail du Conseil sur l’application de la loi sur la surveillance obligatoire de Chat Control 2.0

- 3 avril 2024 : Discussion du groupe de travail du Conseil chargé de l’application de la loi sur la surveillance obligatoire de Chat Control 2.0

- 10 avril 2024 : Vote du Parlement européen sur le résultat du trilogue sur l’extension de la surveillance volontaire des messageries (Chat Control 1.0)

- 15 avril 2024 : Discussion du groupe de travail du Conseil sur l’application de la loi sur la surveillance obligatoire du chatcontrol v2

- 7 mai 2024 (à confirmer) : Discussion du groupe de travail du Conseil chargé de l’application de la loi sur la surveillance obligatoire du ChatControl v2

- 21 mai 2024 (à confirmer) : Discussion du groupe de travail du Conseil sur l’application de la loi sur le surveillance obligatoire du ChatControl v2

- A confirmer : Discussion au sein du COREPER

- 13/14 juin 2024 (prévu) : Les ministres de l’intérieur de l’UE adopteront une position sur la surveillance obligatoire des messageries (Chat Control 2.0).

- Après les élections européennes de 2024 : Négociations en trilogue envisagées sur le texte final de la législation Chatcontrol 2.0 entre la Commission, le Parlement et le Conseil, ainsi que l’adoption du résultat.

Les négociateurs

Les acteurs impliqués au Parlement européen : Rapporteur et rapporteurs fictifs

Pourquoi cette loi vous concerne ?

Analyse des communications :

- Toutes vos discussions par messageries instantanées ou par courriel seront automatiquement scannées pour trouver des contenus douteux. Rien ne pourra être confidentiel ou secret. Il n’y aura pas besoin d’une décision d’un tribunal pour scanner vos messages : ce sera fait systématiquement et automatiquement.

- Si un algorithme classe le contenue de votre message comme douteux, vos photos privées ou intimes pourront être visionnées par le personnel et les sous-traitants d’entreprises internationales ou directement par les services de polices. Toutes vos photos de nudes peuvent être visionnées par des gens que vous ne connaissez pas et possiblement être mises entre de mauvaises mains.

- Les flirts et les sextos peuvent être lus par le personnel et les sous-traitants d’entreprises internationales et par les autorités policières, car les filtres de reconnaissance de texte recherchant de la « corruption de mineurs » signalent souvent à tort les conversations intimes.

- Vous pouvez être faussement dénoncé·e et faire l’objet d’une enquête pour diffusion présumée de matériel pédopornographique. Les algorithmes d’analyse de messageries sont connus pour signaler des photos de vacances tout à fait légales d’enfants sur une plage, par exemple. Selon les autorités de la police fédérale suisse, 80 % des signalements générés par des machines s’avèrent sans fondement. De même, en Irlande, seuls 20 % des signalements NCMEC reçus en 2020 ont été confirmés comme étant réellement des « documents relatifs à la maltraitance d’enfants ». En Allemagne, près de 40 % des procédures d’enquête criminelle ouvertes pour pédopornographie visent des mineurs.

- Durant votre prochain voyage à l’étranger, attendez vous à avoir des problèmes. Des signalements automatiques sur vos communications peuvent avoir été transférés à d’autres pays, comme les Etats-Unis d’Amérique où la protection des données personnelles n’existe pas. – with incalculable results.

- Les services de renseignement et les hackers pourront espionner vos communications privées. Si le chiffrement des applications de communication est supprimé pour permettre l’analyse de vos messages, la porte sera alors ouverte à quiconque en aura les moyens techniques de lire vos échanges.

- Ce n’est que le début. Une fois la technologie d’analyse de messagerie établie, il devient très facile de l’utiliser à d’autres fins. Et qui garantit que ces machines à incriminer ne seront pas utilisées à l’avenir sur nos smartphones et nos ordinateurs portables ?

Vérification de l’âge :

- Vous ne pourrez plus créer d’email ou de comptes anonymes sans présenter une pièce d’identité ou un photo de votre visage, vous rendant identifiable et vulnérables à des fuites de données. Cela limite par exemple les conversations sensibles liées à la sexualité, la communication de contenu anonyme (ex : lanceurs d’alertes), ainsi que les activités politiques.

- Si vous avez moins de 18 ans, vous ne pourrez plus installer les applications suivantes via les magasins d’applications (raison donnée : risque de corruption de mineurs) : des applications de messagerie comme Whatsapp, Snapchat, Telegram ou Twitter, des applications de réseaux sociaux comme Instagram, TikTok ou Facebook, des jeux comme FIFA, Minecraft, GTA, Call of Duty, Roblox, des applications de rencontre, des application de visioconférence comme Zoom, Skype, Facetime.

- Même si vous n’utilisez pas de magasins d’application, l’opérateur du service vérifiera votre âge. Si vous avez moins de 16 ans, vous ne pourrez plus utiliser Whatsapp du fait des règles de vérification d’âge ; idem pour les fonctions en ligne du jeu FIFA 23. Si vous avez moins de 13 ans, vous ne pourrez plus utiliser TikTok, Snapchat ou Instagram.

Cliquez ici pour d’autres arguments contre l’analyse automatisée des messageries

Cliquez ici pour savoir ce que vous pouvez faire pour arrêter la surveillance des messageries

Ce que vous pouvez faire

Vous craignez que cette loi ne porte massivement atteinte aux droits fondamentaux et qu’elle ne soit pas la bonne approche ?

Signez la pétition « Les enfants méritent un Internet sécurisé et sûr » et partagez-la.

Faites augmenter la pression médiatique sur les négociateurs (c’est le plus important maintenant) :

- Contactez votre gouvernement qui négocie au Conseil. Contactez votre représentation permanente au Conseil ou votre Ministre de l’intérieur.

- Joignez les membres du Parlement européen ! Les rapporteurs fictifs ont l’avantage sur les négociations. Cliquez ci-dessous pour savoir comment les contacter :

- Javier Zarzalejos – rapporteur pour le groupe EPP

- Paul Tang – rapporteur fictif pour le groupe S&D

- Patrick Breyer – rapporteur fictif pour le groupe Greens/EFA

- Hilde Vautmans – rapporteur fictif pour le groupe Renew

- Annalisa Tardino – rapporteur fictif pour le groupe ID

- Vincenzo Sofo – rapporteur fictif pour le groupe ECR

- Cornelia Ernst – rapporteur fictif pour le groupe Left

- Faites-leur part poliment de vos préoccupations concernant la surveillance des conversations (arguments ici). L’expérience montre que les appels téléphoniques sont plus efficaces que les courriers électroniques ou les lettres. Le nom officiel du projet de loi sur la surveillance obligatoire des conversations est « Proposition de règlement établissant des règles pour prévenir et combattre les abus sexuels sur les enfants » (« Proposal for a Regulation laying down rules to prevent and combat child sexual abuse« ).

Parlez-en autour de vous ! Informez les autres des dangers de Chat Control. Retrouvez ici des images et vidéos à partager. Vous pouvez bien sûr créer vos propres images et vidéos.

Générez de l’attention sur les réseaux sociaux ! Utilisez le hashtag #ChatControl

Générez de l’attention médiatique ! Jusqu’ici, très peu de média ont couvert le projet de surveillance des communications de l’UE. Contactez des journaux et demandez-leur d’écrire sur le sujet, en ligne comme dans la presse papier.

Demandez à vos opérateurs de services d’email et de tchat ! Evitez Gmail, Facebook Messenger, Outlook.com et le tchat XBox, où l’analyse automatique des conversations est déjà implémentée. Demandez à vos founisseurs d’email et de tchat s’ils scannent déjà vos messages privés à la recherche de contenu suspect, ou s’ils comptent le faire dans le futur.

Briser les mythes

Lorsque le projet de loi Chat Control a été présenté pour la première fois en mai 2022, la Commission européenne a fait la promotion de ce projet controversé en avançant divers arguments. Les paragraphes qui suivent remettent en question certaines affirmations et les réfutent :

1. « Aujourd’hui, des photos et des vidéos montrant des abus pédosexuels circulent massivement sur Internet. En 2021, 29 millions de cas ont été signalés au Centre national américain pour les enfants disparus et exploités. »

Il est trompeur de parler exclusivement de représentations d’abus pédosexuels dans le contexte de la surveillance des conversations numériques. Certes, le contenu relatif à l’exploitation sexuelle des enfants (ou CSEM [« Child Sexual Exploitation Material »]) comprend souvent des vidéos de violence sexuelle à l’encontre de mineurs (du contenu relatif à l’abus sexuel d’enfants, ou CSAM [« Child Sexual Abuse Material »]). Toutefois, un groupe de travail international composé d’institutions de protection de l’enfance souligne que le contenu criminel comprend également des enregistrements d’actes sexuels ou d’organes sexuels de mineurs dans lesquels aucune violence n’est exercée ou aucune autre personne n’est impliquée. Les enregistrements réalisés dans des situations quotidiennes sont également mentionnés, comme une photo de famille d’une fille en bikini ou nue dans les bottes de sa mère. Les enregistrements réalisés ou partagés à l’insu du mineur sont également inclus. Le CSEM punissable comprend également les bandes dessinées, les dessins, les mangas/animes et les représentations de mineurs fictifs générées par ordinateur. Enfin, les représentations criminelles comprennent également les enregistrements sexuels de mineurs réalisés par eux-mêmes, par exemple pour les transmettre à des partenaires du même âge (« sexting »). L’étude propose donc l’expression « représentations de l’exploitation sexuelle » de mineurs comme une description plus appropriée. Dans ce contexte, les enregistrements d’enfants (jusqu’à 14 ans) et d’adolescents (jusqu’à 18 ans) sont également punissables.

2. « Rien qu’en 2021, 85 millions d’images et de vidéos d’abus pédosexuels ont été signalées dans le monde. »

De nombreuses affirmations trompeuses circulent sur la manière de quantifier l’ampleur des images de mineurs exploités sexuellement (CSEM). Le chiffre utilisé par la Commission européenne pour défendre ses projets provient de l’organisation non gouvernementale américaine NCMEC (National Center for Missing and Exploited Children) et comprend des doublons car les images d’exploitation sexuelle de mineurs sont partagées plusieurs fois et ne sont souvent pas supprimées. Si l’on exclut les doublons, il reste 22 millions d’enregistrements uniques sur les 85 millions signalés.

75 % de tous les signalements du NCMEC de 2021 provenaient de Meta (Facebook, Instagram, Whatsapp). L’analyse interne de Facebook indique que « plus de 90 % [du CSEM sur Facebook en 2020] étaient identiques ou visuellement similaires à des contenus précédemment signalés ». Et les copies de seulement six vidéos étaient responsables de plus de la moitié du contenu d’exploitation des enfants. » Les chiffres cités par le NCMEC ne décrivent donc pas vraiment l’ampleur des enregistrements en ligne de violences sexuelles à l’encontre des enfants. Ils décrivent plutôt la fréquence à laquelle Facebook découvre des copies d’enregistrements dont il a déjà connaissance. Cela aussi est pertinent.

Tous les enregistrements uniques signalés au NCMEC ne montrent pas des violences à l’encontre d’enfants. Les 85 millions de représentations signalées par le NCMEC comprennent également des sextos consensuels, par exemple. Le nombre de représentations d’abus signalées au NCMEC en 2021 était de 1,4 million.

L’Union européenne reçoit 7 % des signalements du NCMEC dans le monde.

En outre, même sur Facebook, où l’analyse des conversations est depuis longtemps utilisé de manière volontaire, les chiffres relatifs à la diffusion de matériel abusif continuent d’augmenter. L’analyse automatisée des conversations n’est donc pas une solution.

3. « Augmentation de 64 % des signalements d’abus pédosexuels confirmés en 2021 par rapport à l’année précédente. »

Le fait que les algorithmes d’analyse automatisée des conversations implémentés volontaires par les grands opérateurs américains aient signalé plus de CSEM n’indique pas comment la quantité de CSEM a évolué dans l’ensemble. La configuration même des algorithmes a un impact important sur le nombre de signalements. En outre, cette augmentation montre que la circulation des CSEM ne peut pas être contrôlée au moyen d’un système de surveillance des conversations.

4. « L’Europe est la plaque tournante mondiale pour la plupart de ces contenus. »

7 % des signalements du NCMEC sont adressés à l’Union européenne. Par ailleurs, les services de police européens, tels que Europol et le BKA, ne signalent sciemment pas les contenus abusifs aux services de stockage pour qu’ils soient retirés, de sorte que la quantité de contenus stockés ici ne peut pas diminuer.

5. « Une enquête soutenue par Europol sur la base d’un signalement d’un fournisseur de services en ligne a permis de sauver 146 enfants dans le monde entier, et plus de 100 suspects ont été identifiés dans l’UE. »

Le signalement a été établi par un fournisseur de services de stockage dans le cloud, et non par un fournisseur de services de communication. Pour surveiller le stockage cloud, il n’est pas nécessaire d’imposer la surveillance des communications de chacun. Si l’on veut attraper les auteurs de délits en ligne liés à des contenus pédopornographiques, il faut utiliser des « honeypots » ou d’autres méthodes qui ne nécessitent pas de surveiller les communications de l’ensemble de la population.

6. « Les moyens existants de détection des contenus pertinents ne seront plus disponibles à l’expiration de la solution provisoire actuelle. »

Les fournisseurs de services d’hébergement (hébergeurs de fichiers, clouds) et les opérateurs de réseaux sociaux seront autorisés à poursuivre l’analyse automatisée après l’expiration de l’exemption à ePrivacy. Pour les opérateurs de services de communication, le règlement implémentant l’analyse automatisée volontaire [Chat Control 1.0] pourrait être prolongé sans exiger que tous les fournisseurs y adhèrent.

7. Ces métaphores : L’analyse automatisée des conversations est « comme un filtre anti-spam » / « comme un aimant qui cherche une aiguille dans une botte de foin : l’aimant ne voit pas le foin » / « comme un chien policier qui renifle des lettres : il n’a aucune idée de ce qu’elles contiennent ». Le contenu de votre communication ne sera vu par personne s’il la recherche n’aboutit pas à un résultat. « La détection à des fins de cybersécurité existe déjà, comme la détection de liens dans WhatsApp » ou les filtres anti-spam.

Les filtres anti-spam ou anti-logiciels malveillants ne divulguent pas le contenu des communications privées à des tiers et n’entraînent pas le signalement de personnes innocentes. Ils n’entraînent pas la suppression ou le blocage à long terme de profils sur les réseaux sociaux ou les services en ligne.

8. « En ce qui concerne la détection de nouveaux contenus abusifs sur le net, le taux de réussite est largement supérieur à 90 %. … Certaines technologies existantes de détection de corruption de mineurs (comme celle de Microsoft) ont un « taux de précision » de 88 %, avant examen par un humain. »

Compte tenu du nombre ingérable de messages, même un faible taux d’erreur se traduit par d’innombrables faux positifs qui peuvent dépasser de loin le nombre de messages corrects. Même avec un taux de réussite de 99 %, cela signifie que sur les 100 milliards de messages envoyés quotidiennement via Whatsapp, 1 milliard (c’est-à-dire 1 000 000 000) de faux positifs devraient être vérifiés. Et ce, chaque jour et que pour cette seule plateforme. La « charge de l’examen humain » qui pèserait sur les services de police serait immense, alors que l’arriéré et la surcharge de ressources jouent déjà en leur défaveur.

Par ailleurs, une demande d’accès à l’information par l’ex-député européen Felix Reda a révélé que ces affirmations sur la précision des technologies de détection proviennent de l’industrie-même, de ceux qui ont un intérêt direct dans ces affirmations parce qu’ils veulent vous vendre une technologie de détection (Thorn, Microsoft). Ils refusent de soumettre leur technologie à des tests indépendants et nous ne devrions pas prendre leurs affirmations pour argent comptant.

La surveillance de masse n’est pas la bonne approche pour lutter contre la « pédopornographie » et l’exploitation sexuelle

- L’analyse des messages privés et des tchats ne permet pas d’endiguer la propagation du CSEM. Facebook, par exemple, pratique l’analyse automatisée des conversations depuis des années, et le nombre de signalements automatisés a augmenté chaque année, atteignant récemment 22 millions en 2021.

- L’analyse obligatoire des tchats ne permettra pas de détecter les auteurs qui enregistrent et partagent du contenu d’exploitation sexuelle des enfants. Les abuseurs ne partagent pas leur contenu par email ou messagerie, mais s’organisent par l’intermédiaire de forums secrets autogérés dépourvus d’algorithmes d’analyse automatique. En outre, ils uploadent généralement des images et des vidéos sous forme d’archives chiffrées et ne partagent que les liens et les mots de passe. Les algorithmes d’analyse automatique des conversations ne reconnaissent pas les archives chiffrées ou les liens.

- La bonne approche consisterait à supprimer le CSEM là où il est hébergé en ligne. Cependant, Europol ne signale pas les contenus CSEM connus.

- Le surveillance des conversations nuit à la poursuite des abus pédosexuels en inondant les enquêteurs de millions de signalements automatisés, dont la plupart ne sont pas pertinents sur le plan pénal.

Le surveillance des messageries nuit à tout le monde

- Tous les citoyens sont soupçonnés, sans raison, d’avoir éventuellement commis un délit. Les filtres de texte et de photos surveillent tous les messages, sans exception. Aucun juge n’est tenu d’ordonner une telle surveillance, contrairement au monde analogique qui garantit le secret de la correspondance et la confidentialité des communications écrites. Selon une décision de la Cour de justice européenne, l’analyse automatique permanente et générale des communications privées viole les droits fondamentaux (affaire C-511/18, paragraphe 192). Néanmoins, l’UE a aujourd’hui l’intention d’adopter une telle législation. L’annulation par la Cour peut prendre des années. C’est pourquoi nous devons empêcher l’adoption de cette législation en premier lieu.

- La confidentialité des correspondances électroniques privées est sacrifiée. Les utilisateur·ices des services de messagerie, de tchat et de courrier électronique risquent de voir leurs messages privés lus et analysés. Des photos et des textes sensibles peuvent être transmis à des entités inconnues dans le monde entier et tomber entre de mauvaises mains. Le personnel de la NSA a déjà fait circuler des photos de femmes et d’hommes nus par le passé. Un ingénieur de Google a harcelé des mineurs.

- La surveillance aveugle des messageries incrimine à tort des centaines d’utilisateurs chaque jour. Selon la police fédérale suisse, 80 % des contenus signalés par les machines ne sont pas illégaux, par exemple des photos de vacances inoffensives montrant des enfants nus jouant sur une plage. De même, en Irlande, seuls 20 % des signalements NCMEC reçus en 2020 ont été confirmés comme étant du « matériel pédopornographique ».

- Les communications sécurisées par le chiffrement sont menacées. Jusqu’à présent, les messages chiffrés ne peuvent pas être recherchés par les algorithmes. Pour changer cela, il faudrait intégrer des portes dérobées dans les logiciels de messagerie. Dès que ce sera le cas, cette faille de sécurité pourra être exploitée par toute personne disposant des moyens techniques nécessaires, par exemple par des services de renseignement étrangers et des criminels. Les communications privées, les secrets d’affaires et les informations gouvernementales sensibles seraient exposés. Un chiffrement sécurisé est nécessaire pour protéger les minorités, les personnes LGBTQI, les militants pro-démocratie, les journalistes, etc.

- La justice pénale est en cours de privatisation. À l’avenir, les algorithmes d’entreprises comme Facebook, Google et Microsoft décideront quel utilisateur est suspect et lequel ne l’est pas. La législation proposée ne contient aucune exigence de transparence pour les algorithmes utilisés. Dans un État de droit, les enquêtes sur les infractions pénales sont du ressort de juges indépendants et de fonctionnaires sous le contrôle d’un tribunal.

- La surveillance aveugle des messageries crée un précédent et ouvre la voie à des technologies et à une législation plus intrusives. Le déploiement d’une technologie permettant de surveiller automatiquement toutes les communications en ligne est dangereux : elle peut très facilement être utilisée à d’autres fins à l’avenir, par exemple pour des violations de droits d’auteur, l’abus de drogues ou des « contenus préjudiciables ». Dans les États autoritaires, cette technologie sert à identifier et à arrêter les opposants au gouvernement et les défenseurs de la démocratie. Une fois la technologie déployée à grande échelle, il n’y a pas de retour en arrière possible.

La surveillance des messageries nuit aux enfants et aux victimes d’abus

Les partisans de cette mesure affirment que la surveillance aveugle des messageries facilite les poursuites contre l’exploitation sexuelle des enfants. Toutefois, cet argument est controversé, même parmi les victimes d’abus pédosexuels. En fait, la surveillance des messageries peut nuire aux victimes et aux victimes potentielles de l’exploitation sexuelle :

- Les espaces sûrs sont détruits. Les victimes de violences sexuelles ont particulièrement besoin de pouvoir communiquer en toute sécurité et en toute confidentialité pour obtenir des conseils et du soutien, par exemple pour échanger en toute sécurité entre elles, avec leurs thérapeutes ou leurs avocats. L’introduction de la surveillance en temps réel les prive de ces espaces sécurisés. Cela peut décourager les victimes de chercher de l’aide et du soutien.

- Les photos de mineurs nus enregistrées par eux-mêmes (sexting) se retrouvent entre les mains d’employés d’entreprises et de la police, où elles n’ont pas leur place et ne sont pas en sécurité.

- Les mineurs sont criminalisés. Les jeunes, en particulier, partagent souvent des enregistrements intimes entre eux (sexting). Avec la surveillances des messageries, leurs photos et vidéos peuvent se retrouver entre les mains d’enquêteurs criminels. Les statistiques criminelles allemandes montrent que près de 40 % des enquêtes pour pédopornographie visent des mineurs.

- La surveillance aveugle des messageries n’endigue pas la circulation de contenus illégaux, mais rend en fait plus difficile les poursuites contre l’exploitation sexuelle des enfants. Elle encourage les auteurs à entrer dans la clandestinité et à utiliser des serveurs privés chiffrés qui peuvent être impossibles à détecter et à intercepter. Même sur les canaux publics, la surveillance aveugle des messageries ne permet pas d’endiguer le volume de contenu en circulation, comme le montre le nombre sans cesse croissant de signalements automatisés.

Alternatives

Renforcer les capacités des services de police

Actuellement, les capacités des services de police sont tellement insuffisantes qu’il faut souvent des mois, voire des années, pour suivre les pistes et analyser les données collectées. Le contenu connu n’est souvent ni analysé ni supprimé. Les auteurs d’abus ne partagent pas leurs contenus via Facebook ou d’autres canaux similaires, mais sur le darknet. Pour réellement traquer les auteurs et les producteurs, la police doit travailler sous couverture au lieu de gaspiller des capacités limitées en vérifiant des signalements de machines souvent non pertinents. Il est également essentiel de renforcer les unités d’enquête responsables en termes de personnel et de ressources financières, afin de garantir des enquêtes à long terme, approfondies et durables. Il convient d’élaborer et de respecter des normes et des lignes directrices fiables pour le traitement policier des enquêtes sur les abus pédosexuels.

S’attaquer non seulement aux symptômes, mais aussi aux causes profondes

Au lieu d’essayer de contenir par des moyens techniques inefficaces la diffusion de contenu d’exploitation déjà publié, tous les efforts doivent se concentrer sur la prévention de ces enregistrements en premier lieu. La prévention et la formation jouent un rôle essentiel, car la grande majorité des cas d’abus ne sont jamais connus. Les organisations de protection des victimes souffrent souvent d’un financement instable.

Un soutien rapide et facile à obtenir pour les victimes (potentielles)

- Mécanismes de signalement obligatoires pour les services en ligne : Afin d’assurer une prévention efficace des abus en ligne et en particulier de la corruption de mineurs, les services en ligne devraient être tenus de mettre en évidence les fonctions de signalement sur les plateformes. Si le service est destiné aux jeunes ou aux enfants et/ou utilisé par eux, les fournisseurs devraient également être tenus de les informer des risques de corruption de mineurs en ligne.

- Lignes d’assistance téléphonique et centres de conseil : De nombreux services d’assistance téléphonique nationaux qui traitent les cas d’abus signalés sont confrontés à des problèmes financiers. Il est essentiel de veiller à ce que les capacités soient suffisantes pour assurer le suivi des cas signalés.

Améliorer l’éducation aux médias

L’enseignement de la culture numérique dès le plus jeune âge est un élément essentiel de la protection des enfants et des jeunes en ligne. Les enfants eux-mêmes doivent avoir les connaissances et les outils nécessaires pour naviguer sur Internet en toute sécurité. Ils doivent être informés des dangers qui peuvent les guetter en ligne et apprendre à reconnaître et à remettre en question les pratiques de corruption de mineurs. Cela pourrait se faire, par exemple, par le biais de programmes ciblés dans les écoles et les centres de formation, dans lesquels du personnel formé transmettrait des connaissances et mènerait des discussions. Les enfants doivent apprendre à s’exprimer, à réagir et à signaler les abus, même si ceux-ci proviennent de leur sphère de confiance (c’est-à-dire de personnes proches d’eux ou d’autres personnes qu’ils connaissent et en qui ils ont confiance), ce qui est souvent le cas. Ils doivent également avoir accès à des canaux sûrs, accessibles et adaptés à leur âge pour dénoncer sans crainte les abus dont ils sont victimes.

Liste de Documents

- Observatoire législatif du Parlement européen (état des lieux actualisé en permanence)

- Documents du conseil (état des lieux actualisé en permanence)

- Propositions de compromis de la présidence :12354/22 (15 septembre 2022), 13514/22 (12 octobre 2022) et 14008/22 (26 octobre 2022)

- Position commune d’un groupe d’états membres (27 avril 2023)

- Avis du Service juridique du Conseil (26 avril 2023)

- Projet de rapport du rapporteur (25 avril 2023)

- Position des Etats membres sur le chiffrement (12 avril 2023)

- Positions des Etats membres sur les articles 12-15 (12 avril 2023)

- Analyse d’impact complémentaire (avril 2023)

- Compte-rendu fuité de la réunion du groupe de travail « Application de la loi » (LEWP) (16 mars 2023)

- Résumé de la déposition de l’Association allemande de la protection de l’enfance (Der Kinderschutzbund Bundesverband e.V.) lors de l’audition publique du Comité des affaires numériques allemand sur le sujet du « Chat Control » (1 mars 2023)

- Résumé de la déposition du Commissaire fédéral pour la protection des données et la liberté de l’information lors de l’audition publique du Comité des affaires numériques allemand sur le sujet du “Chat Control” (1 mars 2023)

- Résumé de la déposition du Centre contre la Cybercriminalité du Procureur public allemand lors de l’audition publique du Comité des affaires numériques allemand sur le sujet du “Chat Control” (1 mars 2023)

- Présentation des conclusions : Évaluation ciblée de l’impact sur la proposition de la Commission (25 janvier 2023)

- Briefing EPRS (décembre 2022)

- Rapport de progression du Conseil (24 novembre 2022)

- Avis légal du Service de Recherche de la Bundestag allemande (7 octobre 2022)

- Briefing pour la commissaire Ylva Johansson pour une réunion avec un ministre français (27 septembre 2022)

- Avis du Comité économique et social européen (13 septembre 2022)

- Consultations publiques de la Commission (fermé le 12 septembre 2022), voir aussi cette analyse des réponses

- Avis commun EDPB-EDPS 4/2022 (28 juillet 2022)

- Compte-rendu fuité de la réunion du groupe de travail « Application de la loi » (LEWP) (20 juillet 2022)

- Projet de règlement du Chat control obligatoire et analyse d’impact (11 mai 2022)

- Deuxième avis du Comité d’examen de la réglementation (28 mars 2022)

- Avis du Comité d’examen de la réglementation (15 février 2022)

- Revue qualité du Comité d’examen de la réglementation (6 novembre 2021)

- Rapport sur la surveillance volontaire des messageries par Meta, Twitter et Google de 2021

- Une fuite de l’avis de la Commission tire la sonnette d’alarme sur la surveillance de masse des communications privées (23 mars 2022)

- Réponse de la commission en réponse a une lettre multipartite contre la surveillance obligatoire des communications (9 mars 2022)

- Règlement Chat Control basé sur le volontariat

- Avis du Service de Recherche de la Bundestag allemande (4 août 2021)

- Réponses de Europol sur les statistiques des poursuites judiciaires des CSAM (28 avril 2021)

- Avis légal sur la compatibilité de Chat Control avec la jurisprudence de la Cour de justice européenne (mars 2021)

- Analyse d’impact par le Service de recherche du Parlement européen (5 février 2021)

- Réponses de la commission aux questions des membres du Parlement (27 octobre 2020)

- Réponses de la commission aux questions des membres du Parlement (28 septembre 2020)

- Solutions techniques pour surveiller les communications chiffrées de bout en bout (septembre 2020)

Commentaires critiques et lectures complémentaires

Haut-Commissariat aux droits de l’homme : « Rapport sur le droit à la vie privée à l’ère numérique« (4 août 2022)

« Les gouvernements qui cherchent à limiter le chiffrement n’ont souvent pas réussi à démontrer que les restrictions qu’ils imposeraient sont nécessaires pour répondre à un intérêt légitime particulier, compte tenu de la disponibilité de divers autres outils et approches qui fournissent les informations nécessaires à des fins spécifiques d’application de la loi ou à d’autres fins légitimes. Ces mesures alternatives comprennent l’amélioration de la police traditionnelle et l’augmentation de ses ressources, les opérations d’infiltration, l’analyse des métadonnées et le renforcement de la coopération policière internationale ».

Comité des droits de l’enfant des Nations unies, Observation générale n° 25 (2021)

« Toute surveillance numérique des enfants, ainsi que tout traitement automatisé de données à caractère personnel qui y est associé, devrait respecter le droit de l’enfant à la vie privée et ne devrait pas être effectuée de manière systématique, sans discernement ou à l’insu de l’enfant… »

Prostasia Foundation : « Comment la guerre contre le matériel pédopornographique a été perdue« (19 août 2020)

Droits numériques européens (EDRi) : « Surveiller les enfants, est-ce vraiment les protéger ? Nos inquiétudes concernant le règlement CSAM provisoire« (24 septembre 2020)

Organisations de la société civile : « Lettre ouverte : Points de vue de la société civile sur la défense de la vie privée tout en prévenant les actes criminels« (27 octobre 2020)

« nous suggérons que la Commission donne la priorité à ce travail non technique, et à un retrait plus rapide des sites web en infraction, plutôt qu’au filtrage côté client […] »

Contrôleur européen de la protection des données : « Avis sur la proposition de dérogations temporaires à la directive 2002/58/CE aux fins de la lutte contre les abus sexuels commis sur des enfants en ligne« (10 novembre 2020)

« En raison de l’absence d’analyse d’impact accompagnant la proposition, la Commission doit encore démontrer que les mesures envisagées par la proposition sont strictement nécessaires, efficaces et proportionnées pour atteindre l’objectif visé. »

Alexander Hanff (victime d’abus pédosexuels et professionnel de la protection de la vie privée) : « Pourquoi je ne soutiens pas les mesures qui portent atteinte à la vie privée pour lutter contre les abus pédoxuels« (11 novembre 2020)

« En tant que survivant d’abus, je (et des millions d’autres survivants à travers le monde) compte sur des communications confidentielles pour trouver du soutien et dénoncer les crimes dont nous sommes victimes. Supprimer nos droits à la vie privée et à la confidentialité, c’est nous soumettre à d’autres blessures et franchement, nous avons assez souffert. […] peu importe les mesures que nous prenons pour retrouver les agresseurs, peu importe le nombre de libertés ou de droits constitutionnels que nous détruisons pour atteindre cet objectif – cela n’empêchera PAS les enfants d’être victimes d’abus, cela ne fera qu’enfoncer davantage les abus dans la clandestinité, les rendre de plus en plus difficiles à détecter et, en fin de compte, faire en sorte que davantage d’enfants soient victimes d’abus ».

Victime irlandaise d’abus pédosexuels (5 juin 2022)

« Utiliser le voile de la moralité et le prétexte de la protection des plus vulnérables et des plus aimés dans nos sociétés pour introduire cette initiative potentiellement monstrueuse est méprisable. »

Une victime allemande d’abus pédosexuels (25 mai 2022)

« En tant que victime de violences sexuelles, il est particulièrement important pour moi qu’une communication sécurisée soit possible, par exemple dans les groupes d’entraide et avec les thérapeutes. Si le chiffrement est cassé, cela affaiblit également les possibilités pour les personnes affectées par les abus pédosexuels de chercher de l’aide ».

Victime française d’abus pédosexuels (23 mai 2022)

« Ayant moi-même été victime de violences sexuelles lors de mon enfance je suis convaincu que la seule manière d’avancer sur le sujet est l’éducation. La surveillance généralisée des communication n’aidera en rien les enfants à ne plus subir ces violences inacceptables. »

AccessNow : « Les inquiétudes sur les droits fondamentaux au cœur des nouvelles règles de l’UE sur le contenu en ligne » (19 novembre 2020)

« En pratique, cela signifie qu’ils mettraient des entreprises privées en charge d’une question que les autorités publiques devraient traiter »

Association fédérale des avocats (BRAK) (en allemand) : « Stellungnahme zur Übergangsverordnung gegen Kindesmissbrauch im Internet« (24 novembre 2020)

« L’évaluation des faits liés aux abus pédosexuels fait partie du domaine de responsabilité de la profession juridique. Par conséquent, les communications échangées entre les avocats et les clients contiendront souvent des mots-clés pertinents. […] Selon les propositions de la Commission, il est à craindre que dans toutes les constellations susmentionnées, il y ait régulièrement une violation de la confidentialité en raison de l’utilisation inévitable de termes pertinents. »

Alexander Hanff (victime d’abus pédosexuels et militant pour la protection de la vie privée) : « Le Parlement européen est sur le point d’adopter une dérogation qui entraînera la surveillance totale de plus de 500 millions d’Européens« (4 décembre 2020)

« Je n’avais pas d’outils de communication confidentiels lorsque j’ai été violé ; toutes mes communications étaient surveillées par mes agresseurs – je ne pouvais rien faire, je n’avais aucune confiance. Je ne peux m’empêcher de me demander à quel point ma vie aurait été différente si j’avais eu accès à ces technologies modernes. [Le vote prévu sur la dérogation au règlement e-Privacy] rendra les abus plus difficiles à détecter, empêchera les groupes de soutien d’aider les victimes d’abus et DETRUIRA DES VIES.

Contrôleur allemand de la protection des données (en allemand) : « BfDI kritisiert versäumte Umsetzung von EU Richtlinie« (17 Dezember 2020)

« Une surveillance généralisée et non provoquée des canaux de communication numériques n’est ni proportionnée ni nécessaire pour détecter la maltraitance des enfants en ligne. La lutte contre la violence pédosexualle doit faire l’objet de mesures ciblées et spécifiques. Le travail d’enquête incombe aux autorités chargées de l’application de la loi et ne doit pas être confié à des opérateurs privés de services de messagerie ».

Droits numériques européens (EDRi) : Mise sur écoute des communications privées des enfants : Quatre séries de problèmes de droits fondamentaux pour les enfants (et le reste du monde) (10 février 2021)

« Comme pour d’autres types de surveillance de contenu (que ce soit sur des plateformes comme YouTube ou dans les communications privées), le fait de scanner tout ce qui vient de tout le monde, tout le temps crée d’énormes risques de conduire à une surveillance de masse en échouant au test de nécessité et de proportionnalité. En outre, cela crée une pente glissante où nous commençons à surveiller pour des cas moins nuisibles (droit d’auteur), puis nous passons à des questions plus difficiles (abus sexuels sur enfant, terrorisme) et avant que vous ne réalisiez ce qui s’est passé, le fait de tout surveiller tout le temps devient la nouvelle norme ».

Association allemande des avocats (DAV) : « La surveillance indiscriminée des communications est disproportionnée » (9 mars 2021)

« Le DAV est explicitement en faveur de la lutte contre la préparation et la commission d’abus pédosexuels et leur diffusion via Internet par des mesures efficaces au niveau de l’UE. Cependant, le règlement provisoire proposé par la Commission permettrait des atteintes manifestement disproportionnées aux droits fondamentaux des utilisateurs de services de communication basés sur l’internet. En outre, le règlement provisoire proposé ne prévoit pas de garanties procédurales suffisantes pour les personnes concernées. C’est pourquoi la proposition législative doit être rejetée dans son ensemble.

Lettre du Président du Barreau allemand (DAV) et du Président du Barreau fédéral (BRAK) (en allemand) (8 mars 2021)

« Les résultats de recherche positifs avec divulgation ultérieure à des organismes gouvernementaux et non gouvernementaux seraient redoutés non seulement par les accusés, mais surtout par les victimes d’abus pédosexuels. Dans ce contexte, la confidentialité absolue du conseil juridique est indispensable dans l’intérêt des victimes, en particulier dans ces affaires qui sont souvent empreintes de honte. Dans ces cas en particulier, le client doit conserver le pouvoir de décider quel contenu du mandat peut être divulgué à qui. Dans le cas contraire, il est à craindre que les victimes d’abus pédosexuels ne fassent pas appel à un conseil juridique ».

L’autonomie stratégique en danger : Les entreprises technologiques européennes mettent en garde contre l’abaissement des niveaux de protection des données dans l’UE (15 avril 2021)

« Dans le cadre de l’initiative « Lutte contre les abus pédosexuels : détection, retrait et signalement des contenus illicites », l’Union européenne prévoit d’abolir la confidentialité numérique de la correspondance. Afin de détecter automatiquement les contenus illicites, tous les messages privés seront à l’avenir passés au crible. Cette mesure devrait également s’appliquer aux contenus qui ont été protégés jusqu’à présent par un chiffrement de bout en bout performant. Si cette initiative est mise en œuvre selon le plan actuel, elle portera une atteinte considérable à nos idéaux européens et aux fondements indiscutables de notre démocratie, à savoir la liberté d’expression et la protection de la vie privée […]. L’initiative porterait également gravement atteinte à l’autonomie stratégique de l’Europe et donc aux entreprises basées dans l’UE.

Article dans « Welt.de : Des scanners du crime dans tous nos smartphones : l’UE planifie une attaque majeure de surveillance » (en allemand) (4 novembre 2021)

Les experts de la police et du monde universitaire sont plutôt critiques à l’égard du projet de l’UE : d’une part, ils craignent de nombreux faux signalements des scanners et, d’autre part, une fonction d’alibi de la loi. Daniel Kretzschmar, porte-parole du conseil fédéral de l’association des enquêteurs criminels allemands, déclare que la lutte contre les contenus pédosexuels est « extrêmement importante » pour son association. Il est néanmoins sceptique : des personnes innocentes pourraient facilement devenir le point de mire des enquêtes. En même temps, dit-il, privatiser ces enquêtes d’initiative signifie « rendre les forces de l’ordre dépendantes de ces entreprises, alors qu’il s’agit en fait d’une tâche étatique et souveraine ». «

Thomas-Gabriel Rüdiger, directeur de l’Institut de cybercriminologie de l’Université de police de Brandebourg, est également assez critique à l’égard du projet de l’UE. « En fin de compte, il est probable qu’il impactera à nouveau principalement les mineurs », a-t-il déclaré à WELT. M. Rüdiger se réfère aux chiffres des statistiques criminelles, selon lesquels 43 % des délits enregistrés dans le domaine des contenus pédopornographiques seraient imputables aux enfants et aux adolescents eux-mêmes. C’est le cas, par exemple, de ce que l’on appelle le « sexting » et la « pornographie de cour d’école », lorsque des jeunes de 13 et 14 ans s’envoient des photos obscènes.

Les vrais auteurs, ceux que l’on veut réellement attraper, préfèrent probablement ne pas l’être. « Ils sont conscients de ce qu’ils ont fait et utilisent des alternatives. Il est probable que les clés USB et autres supports de données seront de nouveau de plus en plus utilisés », poursuit M. Rüdiger.

Droits numériques européens (EDRi) : Chat Control : 10 principes pour défendre les enfants à l’ère numérique (9 février 2022)

« Conformément à la législation de l’UE en matière de droits fondamentaux, la surveillance ou l’interception de communications privées ou de leurs métadonnées dans le but de détecter, d’enquêter ou de poursuivre le CSAM en ligne doit être limitée aux véritables suspects à l’encontre desquels il existe des soupçons raisonnables, doit être dûment et spécifiquement justifiée, et doit respecter les règles nationales et européennes en matière de police, de procédure régulière, de bonne administration, de non-discrimination et de garanties des droits fondamentaux. »

Droits numériques européens (EDRi) : Une fuite de l’avis de la Commission tire la sonnette d’alarme sur la surveillance de masse des communications privées (23 mars 2022)

A l’approche de la proposition officielle qui sera présentée plus tard dans l’année, nous demandons instamment à tous les commissaires européens de ne pas oublier leurs responsabilités en matière de droits de l’homme et de veiller à ce qu’une proposition qui menace le cœur même du droit des personnes à la vie privée, et la pierre angulaire de la société démocratique, ne soit pas mise en avant.

Conseil des sociétés européennes d’informatique professionnelle (CEPIS) : L’Europe a droit à des communications sécurisées et à un chiffrement efficace (mars 2022)

« De l’avis de nos experts, universitaires et professionnels de l’informatique, tous les efforts visant à intercepter et à surveiller de manière approfondie les communications numériques via l’analyse côté client ont un impact négatif considérable sur la sécurité informatique de millions d’utilisateurs d’Internet et d’entreprises en Europe. Par conséquent, le droit européen à une communication sécurisée et à un chiffrement efficace pour tous doit devenir une norme.